【受付時間】 10:00〜18:00(土日祝日を除く)

【受付時間】 10:00〜18:00

(土日祝日を除く)

イベントカメラは、高時間分解能、低消費電力などの特性により各種論文で多く引用されております。分野は、ロボティクス、コンピュータービジョン、生体力学など様々です。以下は、それぞれの分野における論文及びiniVationの機種について記載しました。研究及び開発のためにぜひご参照ください。

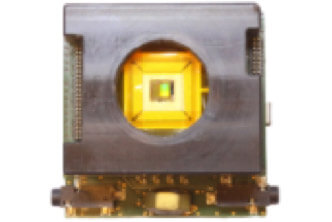

論文一覧に引用されているモデル

|

|

|

|

|

|

|

アルゴリズム (Algorithms)

特徴の検出と追跡(Feature Detection and Tracking)

コーナー検出とトラッキング (Corner Detection and Tracking)

アイトラッキング (Eye Tracking)

オプティカルフロー推定 (Optical Flow Estimation)

視覚像再構成 (Reconstruction of Visual Information)

イベントからの強度画像再構成 (Intensity-Image Reconstruction from events)

ビデオ合成 (Video Synthesis)

超解像技術 (Image super-resolution)

ジョイントフィルタリング/ガイド付きフィルター処理 (Joint/guided filtering)

トーンマッピング (Tone Mapping)

視覚的安定化 (Visual Stabilization)

偏光の再構成 (Polarization Reconstruction)

深度推定(3D再構成)(Depth Estimation (3D Reconstruction))

単眼深度推定 (Monocular Depth Estimation)

ステレオデプス推定 (Stereo Depth Estimation)

SLAM (SLAM (Simultaneous Localization And Mapping))

ローカライゼーション、ロゴモーション推定 (Localization, Ego-Motion Estimation)

ビジュアル・サーボ (Visual Servoing)

セグメンテーション (Segmentation)

オブジェクトのセグメンテーション (Object Segmentation)

モーション・セグメンテーション (Motion Segmentation)

パターン認識 (Pattern Recognition)

物体認識 (Object Recognition)

ジェスチャー認識 (Gesture Recognition)

表現/特徴抽出 (Representation / Feature Extraction)

回帰タスク (Regression Tasks)

学習方法/フレームワーク (Learning Methods / Frameworks)

信号処理 (Signal Processing)

イベント・デノイジング (Event Denoising)

コントロール (Control)

障害物回避 (Obstacle Avoidance)

宇宙 (Space Applications)

触覚センシング・アプリケーション (Tactile Sensing Applications)

オブジェクトのポーズ推定 (Object Pose Estimation)

人間の姿勢推定 (Human Pose Estimation)

ハンドポーズの推定 (Hand Pose Estimation)

データ暗号化 (Data Encryption)

核検証 (Nuclear Verification)

光学 (Optical Applications)

オートフォーカス (Auto-focus)

波面センシング (Wavefront sensing)

データセットとシミュレーター (Datasets and Simulators)

エミュレータとシミュレーター (Emulators and Simulators)

データセット (Datasets (sorted by topic))

人間の姿勢推定 (Human Pose Estimation)

ステレオデプス推定 (Stereo Depth Estimation)

オプティカル・フロー (Optical Flow)

イベントからの強度画像再構成 (Intensity-Image Reconstruction from Events)

ヴィジュアルオドメトリーとSLAM (Visual Odometry and SLAM)

認識 (Recognition)

イベント・デノイジング (Event Denoising)

アルゴリズム (Algorithms)

特徴検出と追跡 (Feature Detection and Tracking)

Event-based attention and tracking on neuromorphic hardware

筆者

Renner, A., Evanusa, M., Sandamirskaya, Y.,

参照されているモデル

DAVIS240C

Robust Event-Based Object Tracking Combining Correlation Filter and CNN Representation

https://www.frontiersin.org/articles/10.3389/fnbot.2019.00082/full

筆者

Li, H., Shi, L.,

参照されているモデル

DAVIS128,DAVIS240C

High-Speed, Real-Time, Spike-Based Object Tracking and Path Prediction on Google Edge TPU

https://par.nsf.gov/servlets/purl/10212648

筆者

Sengupta, J. P., Kubendran, R., Neftci, E., Andreou, A. G.,

参照されているモデル

DAVIS240,DAVIS240C

EventCap: Monocular 3D Capture of High-Speed Human Motions using an Event Camera

https://arxiv.org/pdf/1908.11505.pdf

筆者

Xu, L., Xu, W., Golyanik, V., Habermann, M., Fang, L., Theobalt, C.,

参照されているモデル

DAVIS240C

A Comparative Evaluation of the Detection and Tracking Capability Between Novel Event-Based and Conventional Frame-Based Sensors

https://scholar.afit.edu/etd/3154/

筆者

Boettiger, J. P.,

参照されているモデル

DAVIS128,DAVIS240C,DAVIS346

HASTE: multi-Hypothesis Asynchronous Speeded-up Tracking of Events

https://www.bmvc2020-conference.com/conference/papers/paper_0744.html

筆者

Alzugaray, I., Chli, M.,

参照されているモデル

DAVIS240

E-ACJ: ACCURATE JUNCTION EXTRACTION FOR EVENT CAMERAS

https://arxiv.org/pdf/2101.11251.pdf

筆者

Liu, Z., Fu, Y.,

参照されているモデル

DAVIS240C

Moving Object Detection for Event-based Vision using Graph Spectral Clustering

筆者

Mondal, A., Shashant, R., Giraldo, J. H., Bouwmans, T., Chowdhury, A. S.,

参照されているモデル

DAVIS346

EVENT-DRIVEN FEATURE DETECTION AND TRACKING FOR VISUAL SLAM

https://www.research-collection.ethz.ch/handle/20.500.11850/541700

筆者

Alzugaray, I.,

参照されているモデル

DAVIS240

Object Tracking by Jointly Exploiting Frame and Event Domain

筆者

Zhang, J., Yang, X., Fu, Y., Wei, X., Yin, B., Dong, B.,

参照されているモデル

DAVIS346

Tracking 6-DoF Object Motion from Events and Frames

https://arxiv.org/pdf/2103.15568.pdf

筆者

Li, H., Stueckler, J.,

参照されているモデル

DAVIS240C

High-Temporal-Resolution Object Detection and Tracking Using Images and Events

https://www.mdpi.com/2313-433X/8/8/210

筆者

El Shair, Z., Rawashdeh, S.A.,.,

参照されているモデル

DAVIS240C

Learning Graph-embedded Key-event Back-tracing for Object Tracking in Event Clouds

https://openreview.net/pdf?id=hTxYJAKY85

筆者

Zhu, Z., Hou, J., Lyu, X.,

参照されているモデル

DAVIS346

Data-driven Feature Tracking for Event Cameras

https://arxiv.org/pdf/2211.12826.pdf

筆者

Messikommer, N., Fang, C., Gehrig, M., Scaramuzza, D.,

参照されているモデル

DAVIS240C

Cross-modal Orthogonal High-rank Augmentation for RGB-Event Transformer-trackers

https://arxiv.org/pdf/2307.04129.pdf

筆者

Zhu, Z., Hou, J., Wu DO.,

参照されているモデル

DAVIS346

コーナー検出とトラッキング (Corner Detection and Tracking)

Live Demonstration: A Real-time Event-based Fast Corner Detection Demo based on FPGA

筆者

Liu, H., Kao, W.-T., Delbruck, T.,

参照されているモデル

DAVIS240C

Dynamic Resource-aware Corner Detection for Bio-inspired Vision Sensors

https://arxiv.org/pdf/2010.15507.pdf

筆者

Mohamed, S. A. S., Yasin, J. N., Haghbayan, M.-H., Miele, A., Heikkonen, J., Tenhunen, H., Plosila, J.,

参照されているモデル

DAVIS240C

Asynchronous Corner Tracking Algorithm based on Lifetime of Events for DAVIS Cameras

https://arxiv.org/pdf/2010.15510.pdf

筆者

Mohamed, S. A. S., Yasin, J. N., Haghbayan, M.-H., Miele, A., Heikkonen, J., Tenhunen, H., Plosila, J.,

参照されているモデル

DAVIS240

Evaluation of Event-Based Corner Detectors

https://www.mdpi.com/2313-433X/7/2/25

筆者

Yılmaz, Ö., Simon-Chane, C., Histace A.,

参照されているモデル

DAVIS240C

アイトラッキング (Eye Tracking)

Event-Based Near-Eye Gaze Tracking Beyond 10,000 Hz

https://arxiv.org/pdf/2004.03577.pdf

筆者

Angelopoulos, A.N., Martel, J.N.P., Kohli, A.P.S., Conradt, J., Wetzstein, G.,

参照されているモデル

DAVIS346

3ET: Efficient Event-based Eye Tracking using a Change-Based ConvLSTM Network

https://arxiv.org/pdf/2308.11771.pdf

筆者

Chen, Q., Wang, Z., Liu, S.-C., Gao, C.,

参照されているモデル

DAVIS240

オプティカルフロー推定 (Optical Flow Estimation)

Event Cameras, Contrast Maximization and Reward Functions: an Analysis

筆者

Stoffregen, T., Kleeman, L.,

参照されているモデル

DAVIS240C

Event-Based Motion Segmentation by Motion Compensation

https://rpg.ifi.uzh.ch/docs/ICCV19_Stoffregen.pdf

筆者

Stoffregen, T., Gallego, G., Drummond, T., Kleeman, L., Scaramuzza, D.,

参照されているモデル

DAVIS240C

A Fast Geometric Regularizer to Mitigate Event Collapse in the Contrast Maximization Framework

https://onlinelibrary.wiley.com/doi/10.1002/aisy.202200251

筆者

Shiba, S., Aoki, Y., Gallego, G.,

参照されているモデル

DAVIS240C,DAVIS346

Formulating Event-Based Image Reconstruction as a Linear Inverse Problem With Deep Regularization Using Optical Flow

https://ieeexplore.ieee.org/document/9994038

筆者

Zhang, Z., Yezzi, A., Gallego, G.,

参照されているモデル

DAVIS346

Unsupervised Event-based Learning of Optical Flow, Depth, and Egomotion

筆者

Zhu, A. Z., Yuan, L., Chaney, K., Daniilidis, K.,

参照されているモデル

DAVIS346

Unsupervised Event-Based Optical Flow Using Motion Compensation

https://link.springer.com/chapter/10.1007/978-3-030-11024-6_54

筆者

Zhu, A. Z., Yuan, L., Chaney, K., Daniilidis, K.,

参照されているモデル

DAVIS346

Jointly learning visual motion and confidence from local patches in event cameras

https://www.ecva.net/papers/eccv_2020/papers_ECCV/papers/123510494.pdf

筆者

Kepple, D.R., Lee, D., Prepsius, C., Isler, V., Park, I. M., Lee, D. D.,

参照されているモデル

DAVIS240B

Optical Flow Estimation by Matching Time Surface with Event-Based Cameras

https://www.mdpi.com/1424-8220/21/4/1150

筆者

Nagata, J., Sekikawa, Y., Aoki, Y.,

参照されているモデル

DAVIS346B

Self-Supervised Learning of Event-Based Optical Flow with Spiking Neural Networks

https://proceedings.neurips.cc/paper/2021/hash/39d4b545fb02556829aab1db805021c3-Abstract.html

筆者

Hagenaars, J. J., Paredes-Valles, F., de Croon, G. C. H. E.,

参照されているモデル

DAVIS240C

A Cortically-inspired Architecture for Event-based Visual Motion Processing: From Design Principles to Real-world Applications

筆者

Peveri, F., Testa, S., Sabatini, S. P.,

参照されているモデル

DAVIS346

Event Collapse in Contrast Maximization Frameworks

https://arxiv.org/pdf/2108.10552.pdf

筆者

Gehrig, M., Millhäusler, M., Gehrig, D., Scaramuzza, D.,

参照されているモデル

DAVIS346

Fast Event-Based Optical Flow Estimation by Triplet Matching

https://ieeexplore.ieee.org/document/10008035

筆者

Shiba, S., Aoki, Y., Gallego, G.,

参照されているモデル

DAVIS240C,DAVIS346

視覚像再構成 (Reconstruction of Visual Information)

イベントからの強度画像再構成 (Intensity-Image Reconstruction from events)

Events-to-Video: Bringing Modern Computer Vision to Event Cameras

https://rpg.ifi.uzh.ch/docs/CVPR19_Rebecq.pdf

筆者

Rebecq, H., Ranftl, R., Koltun, V., Scaramuzza, D.,

参照されているモデル

DAVIS240C,DAVIS346

Fast Image Reconstruction with an Event Camera https://openaccess.thecvf.com/content_WACV_2020/papers/Scheerlinck_Fast_Image_Reconstruction_with_an_Event_Camera_WACV_2020_paper.pdf

筆者

Scheerlinck, C., Rebecq, H., Gehrig, D., Barnes, N., Mahony, R., Scaramuzza, D.,

参照されているモデル

DAVIS240C,DAVIS346

Reducing the Sim-to-Real Gap for Event Cameras

https://www.ecva.net/papers/eccv_2020/papers_ECCV/papers/123720528.pdf

筆者

Stoffregen, T., Scheerlinck, C., Scaramuzza, D., Drummond, T., Barnes, N., Kleeman, L., Mahony, R.,

参照されているモデル

DAVIS240C

CED: Color Event Camera Dataset

https://rpg.ifi.uzh.ch/CED.html

筆者

Scheerlinck, C., Rebecq, H., Stoffregen, T., Barnes, N., Mahony, R., Scaramuzza, D.,

参照されているモデル

DAVIS346

Learning to See in the Dark with Events

https://www.ecva.net/papers/eccv_2020/papers_ECCV/papers/123630647.pdf

筆者

Zhang, S., Zhang, Y., Jiang, Z., Zou, D., Ren, J., Zhou, B.,

参照されているモデル

DAVIS240C

Back to Event Basics: Self-Supervised Learning of Image Reconstruction for Event Cameras via Photometric Constancy

筆者

Paredes-Valles, F., de Croon, G. C. H. E.,

参照されているモデル

DAVIS240C

Learning to Reconstruct High Speed and High Dynamic Range Videos from Events

筆者

Zou, Y., Zheng, Y., Takatani, T., Fu, Y.,

参照されているモデル

DAVIS346

Event-based Synthetic Aperture Imaging with a Hybrid Network

筆者

Zhang, X., Liao, W., Yu, L., Yang, W., Xia, G.-S.,

参照されているモデル

DAVIS346

HyperE2VID: Improving Event-Based Video Reconstruction via Hypernetworks

https://arxiv.org/abs/2305.06382

Ercan, B., Eker, O., Saglam, C., Erdem, A., Erdem, E.

参照されているモデル

DAVIS240C,DAVIS346,,DAVIS346B

Neuromorphic Imaging with Joint Image Deblurring and Event Denoising

https://arxiv.org/abs/2309.16106

筆者

Zhang, P., Liu, H., Ge, Z., Wang, C., Lam, E. Y.,

参照されているモデル

DAVIS240C,DAVIS346

E2HQV: High-Quality Video Generation from Event Camera via Theory-Inspired Model-Aided Deep Learning

https://arxiv.org/abs/2401.08117

筆者

Qu, Q., Shen, Y., Chen, X., Chung, Y.Y., Liu, T.,

参照されているモデル

DAVIS240C

ビデオ合成 (Video Synthesis)

High Frame Rate Video Reconstruction based on an Event Camera

https://arxiv.org/pdf/1903.06531.pdf

筆者

Pan, L., Hartley, R., Scheerlinck, C., Liu, M., Yu, X., Dai, Y.,

参照されているモデル

DAVIS240,DAVIS346

Learning Event-Based Motion Deblurring

筆者

Jiang, Z., Zhang, Y., Zou, D., Ren, J., Lv, J., Liu, Y.,

参照されているモデル

DAVIS240C

Hybrid Deblur Net: Deep Non-Uniform Deblurring With Event Camera

https://ieeexplore.ieee.org/document/9165110

筆者

Zhang, L., Zhang, H., Chen, J., Wang, L.,

参照されているモデル

DAVIS240C

Time Lens: Event-based Video Frame Interpolation

筆者

Tulyakov, S., Gehrig, D., Georgoulis, S., Erbach, J., Gehrig, M., Li, Y., Scaramuzza, D.,

参照されているモデル

DAVIS240,DAVIS346

EFI-Net: Video Frame Interpolation from Fusion of Events and Frames

筆者

Paikin, G., Ater, Y., Shaul, R., Soloveichik, E.,

参照されているモデル

DAVIS240

超解像技術 (Image super-resolution)

EventSR: From Asynchronous Events to Image Reconstruction, Restoration, and Super-Resolution via End-to-End Adversarial Learning

筆者

Wang, L., Kim, T.-K., Yoon, K.-J.,

参照されているモデル

DAVIS240

Turning Frequency to Resolution: Video Super-resolution via Event Cameras

筆者

Jing, Y., Yang, Y., Wang, X., Song, M., Tao, D.,

参照されているモデル

DAVIS346

EventZoom: Learning to Denoise and Super Resolve Neuromorphic Events

筆者

Duan, P., Wang, Z. W., Zhou, X., Ma, Y., Shi, B.,

参照されているモデル

DAVIS240,DAVIS346

EvIntSR-Net: Event Guided Multiple Latent Frames Reconstruction and Super-resolution

筆者

Han, J., Yang, Y., Zhou, C., Xu, C., Shi, B.,

参照されているモデル

DAVIS240,DAVIS346

ジョイントフィルタリング/ガイド付きフィルター処理 (Joint/guided filtering)

Joint Filtering of Intensity Images and Neuromorphic Events for High-Resolution Noise-Robust Imaging

筆者

Wang, Z. W., Duan, P., Cossairt, O., Katsaggelos, A., Huang, T., Shi, B.,

参照されているモデル

DAVIS240,DAVIS240B,RGB-DAVIS

トーンマッピング (Tone Mapping)

Neuromorphic Camera Guided High Dynamic Range Imaging

筆者

Han, J., Zhou, C., Duan, P., Tang, Y., Xu, C., Xu, C., Huang, T., Shi, B.,

参照されているモデル

DAVIS240

視覚的安定化 (Visual Stabilization)

Stabilizing Event Data on Flapping-wing Robots for Simpler Perception

https://zenodo.org/record/6602940/files/Workshop_Flapping_Wing_Challenges.pdf

筆者

Rodriguez-Gomez, J.P., Gallego, G., Martinez-de Dios, J.R., Ollero, A.

参照されているモデル

DAVIS346

偏光の再構成 (Polarization Reconstruction)

Deep Polarization Reconstruction With PDAVIS Events

筆者

Mei, H., Wang, Z., Yang, X., Wei, X., Delbruck, T.,

参照されているモデル

PDAVIS

深度推定(3D再構成)(Depth Estimation (3D Reconstruction))

単眼深度推定 (Monocular Depth Estimation)

Learning Monocular Dense Depth from Events

https://arxiv.org/pdf/2010.08350.pdf

筆者

Hidalgo-Carrió J., Gehrig D., Scaramuzza, D.,

参照されているモデル

DAVIS346B

Neuromorphic Fringe Projection Profilometry

https://ieeexplore.ieee.org/document/9166707

筆者

Mangalore, A. R., Seelamantula, C. S., Thakur, C. S.,

参照されているモデル

DAVIS346

Event-based Bispectral Photometry using Temporally Modulated Illumination

筆者

Takatani, T., Ito, Y., Ebisu, A., Zheng, Y., Aoto, T.,

参照されているモデル

DAVIS346

ESL: Event-based Structured Light

https://rpg.ifi.uzh.ch/docs/3DV21_Muglikar_ESL.pdf

筆者

Muglikar, M., Gallego, G., Scaramuzza, D.,

参照されているモデル

DAVIS240,DAVIS346

Event Guided Depth Sensing

https://rpg.ifi.uzh.ch/docs/3DV21_Muglikar.pdf

筆者

Muglikar, M., Moeys, D., Scaramuzza, D.,

参照されているモデル

DAVIS240,DAVIS346

ステレオデプス推定 (Stereo Depth Estimation)

Stereo Event Lifetime and Disparity Estimation for Dynamic Vision Sensors

https://arxiv.org/pdf/1907.07518.pdf

筆者

Hadviger, A., Markovic, I., Petrovic, I.,

参照されているモデル

DAVIS240

Stereo Dense Depth Tracking Based on Optical Flow using Frames and Events

https://lamor.fer.hr/images/50036607/hadviger-disparity-advrob.pdf

筆者

Hadviger, A., Marković, I., Petrović, I.,

参照されているモデル

DAVIS346

Stereo Hybrid Event-Frame (SHEF) Cameras for 3D Perception

https://ieeexplore.ieee.org/document/9636312

筆者

Wang, Z., Pan, L., Ng, Y., Zhuang, Z., Mahony, R.,

参照されているモデル

DAVIS346

Multi-Event-Camera Depth Estimation and Outlier Rejection by Refocused Events Fusion

https://arxiv.org/pdf/2207.10494.pdf

筆者

Ghosh, S., Gallego, G.,

参照されているモデル

DAVIS240,DAVIS240C,DAVIS346

Self-Supervised Intensity-Event Stereo Matching

https://arxiv.org/abs/2211.00509

筆者

Gu, J., Zhou, J., Chu, R.S.W., Chen, Y., Zhang, J., Cheng, X., Zhang, S., Ren, J.S.,

参照されているモデル

DAVIS240C

SLAM (SLAM (Simultaneous Localization And Mapping))

ローカライゼーション、ロゴモーション推定 (Localization, Ego-Motion Estimation)

Real-Time 6DOF Pose Relocalization for Event Cameras with Stacked Spatial LSTM Networks

筆者

Nguyen, A., Do, T.-T., Caldwell, D. G., Tsagarakis, N. G.,

参照されているモデル

DAVIS240C

Event-based, Direct Camera Tracking from a Photometric 3D Map using Nonlinear Optimization

https://rpg.ifi.uzh.ch/docs/ICRA19_Bryner.pdf

筆者

Bryner, S., Gallego, G., Rebecq, H., Scaramuzza, D.,

参照されているモデル

DAVIS240C,DAVIS346

Event-Based Visual Place Recognition With Ensembles of Temporal Windows

https://ieeexplore.ieee.org/document/9201344

筆者

Fischer, T., Milford, M.,

参照されているモデル

DAVIS346

Entropy Minimisation Framework for Event-based Vision Model Estimation

https://www.ecva.net/papers/eccv_2020/papers_ECCV/papers/123500154.pdf

筆者

Nunes, U.M., Demiris, Y.,

参照されているモデル

DAVIS240,DAVIS346B

Live Demonstration: Incremental Motion Estimation for Event-based Cameras by Dispersion Minimisation

筆者

Nunes, U.M., Demiris, Y.,

参照されているモデル

DAVIS346B

High-speed event-based camera tracking

https://www.bmvc2020-conference.com/conference/papers/paper_0366.html

筆者

Chamorro, W., Andrade-Cetto, J., Solà, J.,

参照されているモデル

DAVIS240C

The Spatio-Temporal Poisson Point Process: A Simple Model for the Alignment of Event Camera Data

https://vis-www.cs.umass.edu/motionSegmentation/website_ICCV21/ICCV2021-paper.pdf

筆者

Gu, C., Learned-Miller, E., Sheldon, D., Gallego, G., Bideau, P.,

参照されているモデル

DAVIS240,DAVIS240C

Continuous Event-Line Constraint for Closed-Form Velocity Initialization

https://www.bmvc2021-virtualconference.com/assets/papers/0877.pdf

筆者

Peng, X., Xu, W., Yang, J., Kneip, L.,

参照されているモデル

DAVIS240,DAVIS346

Event-Based Line SLAM in Real-Time

https://ieeexplore.ieee.org/document/9810191

筆者

Chamorro, W. O., Solà, J., Andrade-Cetto, J.,

参照されているモデル

DAVIS240

Cross-modal Place Recognition in Image Databases using Event-based Sensors

https://arxiv.org/abs/2307.01047

筆者

Ji, X., Wei, J., Wang, Y., Shang, H., Kneip, L.,

参照されているモデル

DAVIS346,DAVIS RGB

ビジュアル・サーボ (Visual Servoing)

Neuromorphic Eye-in-Hand Visual Servoing

https://ieeexplore.ieee.org/document/9395430

筆者

Muthusamy, R., Ayyad, A., Halwani, M., Swart, D., Gan, D., Seneviratne, L., Zweiri, Y.,

参照されているモデル

DAVIS240

Gomez Eguiluz, A., Rodriguez-Gomez, J.P., Martinez-de Dios, J.R., Ollero, A.,

筆者

Muthusamy, R., Ayyad, A., Halwani, M., Swart, D., Gan, D., Seneviratne, L., Zweiri, Y.,

参照されているモデル

DAVIS240

Globally Optimal Contrast Maximisation for Event-based Motion Estimation

https://arxiv.org/pdf/2002.10686.pdf

筆者

Liu, D., Parra, A., Chin, T.-J.,

参照されているモデル

DAVIS240C

Event-Based Angular Velocity Regression with Spiking Networks

https://arxiv.org/pdf/2003.02790.pdf

筆者

Gehrig, M., Shrestha, S. B., Mouritzen, D., Scaramuzza, D.,

参照されているモデル

DAVIS240C

Spatiotemporal Registration for Event-based Visual Odometry

筆者

Liu, D., Parra, A., Chin, T.-J.,

参照されているモデル

DAVIS240C

Visual Odometry with an Event Camera Using Continuous Ray Warping and Volumetric Contrast Maximization

https://www.mdpi.com/1424-8220/22/15/5687

筆者

Wang, Y., Yang, J., Peng, X., Wu, P., Gao, L., Huang, K., Chen, J., Kneip, L.,

参照されているモデル

DAVIS240C

Event-aided Direct Sparse Odometry

https://rpg.ifi.uzh.ch/docs/CVPR22_Hidalgo.pdf

筆者

Hidalgo-Carrió J., Gallego, G., Scaramuzza, D.,

参照されているモデル

DAVIS240C,DAVIS240B,DAVIS346,DAVIS346B

A 5-Point Minimal Solver for Event Camera Relative Motion Estimation

筆者

Gao, L., Su, H., Gehrig, D., Cannici, M., Scaramuzza, D., Kneip, L.,

参照されているモデル

DAVIS240C,DAVIS346

Research on Event Accumulator Settings for Event-Based SLAM

https://arxiv.org/abs/2112.00427

筆者

Xiao, K., Wang, G., Chen, Y., Xie, Y., Li, H.,

参照されているモデル

DAVIS240,DAVIS346

Event-Based Visual-Inertial Odometry on a Fixed-Wing Unmanned Aerial Vehicle

https://scholar.afit.edu/etd/2276/

筆者

Nelson, K. J.,

参照されているモデル

DAVIS240C,DAVIS346

Event-Based Visual-Inertial Odometry Using Smart Features

https://scholar.afit.edu/etd/3172/

筆者

Friedel, Z. P.,

参照されているモデル

DAVIS240C

Event-IMU fusion strategies for faster-than-IMU estimation throughput

筆者

Chamorro, W. O., Solà, J., Andrade-Cetto, J.,

参照されているモデル

DAVIS346

ESVIO: Event-based Stereo Visual Inertial Odometry

https://arxiv.org/abs/2212.13184

筆者

Chen, P., Guan, W., Lu, P.,

参照されているモデル

DAVIS346

セグメンテーション (Segmentation)

オブジェクトのセグメンテーション (Object Segmentation)

EvDistill: Asynchronous Events to End-task Learning via Bidirectional Reconstruction-guided Cross-modal Knowledge Distillation

筆者

Wang, L., Chae, Y., Yoon, S.-H., Kim, T.-K., Yoon, K.-J.,

参照されているモデル

DAVIS346

HALSIE: Hybrid Approach to Learning Segmentation by Simultaneously Exploiting Image and Event Modalities

https://arxiv.org/abs/2211.10754

筆者

Biswas, S.D., Kosta, A., Liyanagedera, C., Apolinario, M., Roy, K.,

参照されているモデル

DAVIS346B

モーション・セグメンテーション (Motion Segmentation)

Learning Visual Motion Segmentation Using Event Surfaces

筆者

Mitrokhin, A., Hua, Z., Fermüller, C., Aloimonos, Y.,

参照されているモデル

DAVIS346C

0-MMS: Zero-Shot Multi-Motion Segmentation With A Monocular Event Camera

https://arxiv.org/abs/2006.06158

筆者

Parameshwara, C. M., Sanket, N. J., Gupta, A., Fermüller, C., Aloimonos, Y.,

参照されているモデル

DAVIS240B,DAVIS346C

Event-based Motion Segmentation with Spatio-Temporal Graph Cuts

https://arxiv.org/pdf/2012.08730.pdf

筆者

Zhou, Y., Gallego, G., Lu, X., Liu, S., Shen, S.,

参照されているモデル

DAVIS240,DAVIS346

Un-EvMoSeg: Unsupervised Event-based Independent Motion Segmentation

https://arxiv.org/pdf/2312.00114.pdf

筆者

Wang, Z., Guo, J., Daniilidis, K.,

参照されているモデル

DAVIS16,DAVIS346

パターン認識 (Pattern Recognition)

物体認識 (Object Recognition)

Graph-Based Object Classification for Neuromorphic Vision Sensing

筆者

Bi, Y., Chadha, A., Abbas, A., Bourtsoulatze, E., Andreopoulos, Y.,

参照されているモデル

DAVIS128,DAVIS240C

Multi-Cue Event Information Fusion for Pedestrian Detection With Neuromorphic Vision Sensors

https://www.frontiersin.org/articles/10.3389/fnbot.2019.00010/full

筆者

Chen, G., Cao, H., Ye, C., Zhang, Z., Liu, X., Mo, X., Qu, Z., Conradt, J., Röhrbein, F., Knoll, A.,

参照されているモデル

DAVIS240

Learning to Detect Objects with a 1 Megapixel Event Camera

https://papers.nips.cc/paper/2020/file/c213877427b46fa96cff6c39e837ccee-Paper.pdf

筆者

Perot, E., de Tournemire, P., Nitti, D., Masci, J., Sironi, A.,

参照されているモデル

DAVIS346

Event Camera Based Real-Time Detection and Tracking of Indoor Ground Robots

https://arxiv.org/pdf/2102.11916v1.pdf

筆者

Patel, H., Iaboni, C., Lobo, D., Choi, J., Abichandani, P.,

参照されているモデル

DAVIS346

ジェスチャー認識 (Gesture Recognition)

DHP19: Dynamic Vision Sensor 3D Human Pose Dataset

筆者

Calabrese, E., Taverni, G., Easthope, C., Skriabine, S., Corradi, F., Longinotti, L., Eng, K., Delbruck, T.,

参照されているモデル

DAVIS240

EVENT-BASED ACTION RECOGNITION USING TIMESTAMP IMAGE ENCODING NETWORK

https://arxiv.org/pdf/2009.13049.pdf

筆者

Huang, C.,

参照されているモデル

DAVIS240C

表現/特徴抽出 (Representation / Feature Extraction)

EventNet: Asynchronous Recursive Event Processing

筆者

Sekikawa, Y., Hara, K., Saito, H.,

参照されているモデル

DAVIS240

Dynamic Vision Sensor integration on FPGA-based CNN accelerators for high-speed visual classification

https://arxiv.org/abs/1905.07419

筆者

Linares-Barranco, A., Rios-Navarro, A., Tapiador-Morales, R., Delbruck, T.,

参照されているモデル

DAVIS240C

Motion Equivariant Networks for Event Cameras with the Temporal Normalization Transform

https://arxiv.org/abs/1902.06820

筆者

Zhu, A.Z., Wang, Z., Daniilidis, K.,

参照されているモデル

DAVIS346

Graph-based Spatial-temporal Feature Learning for Neuromorphic Vision Sensing

https://arxiv.org/pdf/1910.03579.pdf

筆者

Bi, Y., Chadha, A., Abbas, A., Bourtsoulatze, E., Andreopoulos, Y.,

参照されているモデル

DAVIS128,DAVIS240C

EventGAN: Leveraging Large Scale Image Datasets for Event Cameras

https://arxiv.org/pdf/1912.01584.pdf

筆者

Zhu, A., Wang, Z., Khant, K., Daniilidis, K.,

参照されているモデル

DAVIS346

回帰タスク (Regression Tasks)

Integrating Event-based Dynamic Vision Sensors with Sparse Hyperdimensional Computing: A Low-power Accelerator with Online Capability

https://www.research-collection.ethz.ch/handle/20.500.11850/425534

筆者

Hersche, M., Mello Rella, E., Di Mauro, A., Benini, L., Rahimi, A.,

参照されているモデル

DAVIS346B

学習方法/フレームワーク (Learning Methods / Frameworks)

Pushing the Limits of Asynchronous Graph-based Object Detection with Event Cameras

https://arxiv.org/abs/2211.12324

筆者

Gehrig D., Scaramuzza D.,

参照されているモデル

DAVIS240

A Hybrid ANN-SNN Architecture for Low-Power and Low-Latency Visual Perception

https://arxiv.org/abs/2303.14176

筆者

Aydin, A., Gehrig, M., Gehrig, D., Scaramuzza, D.,

参照されているモデル

DAVIS346

信号処理 (Signal Processing)

イベント・デノイジング (Event Denoising)

Event Probability Mask (EPM) and Event Denoising Convolutional Neural Network (EDnCNN) for Neuromorphic Cameras

筆者

Baldwin R.W., Almatrafi M., Asari V., Hirakawa K.,

参照されているモデル

DAVIS346

A Noise Filter for Dynamic Vision Sensors using Self-adjusting Threshold

https://arxiv.org/pdf/2004.04079.pdf

筆者

Guo, S., Kang, Z., Wang, L., Zhang, L., Chen, X., Li, S., Xu, W.,

参照されているモデル

DAVIS240C

Neuromorphic Camera Denoising Using Graph Neural Network-Driven Transformers

https://ieeexplore.ieee.org/document/9893571

筆者

Alkendi, Y., Azzam, R., Ayyad, A., Javed, S., Seneviratne, L., Zweiri, Y.,

参照されているモデル

DAVIS346,DAVIS346C

コントロール (Control)

Towards Low-Latency High-Bandwidth Control of Quadrotors using Event Cameras

https://arxiv.org/pdf/1911.04553.pdf

筆者

Sugimoto, R., Gehrig, M., Brescianini, D., Scaramuzza, D.,

参照されているモデル

DAVIS240C

Towards neuromorphic control: A spiking neural network based PID controller for UAV

https://www.roboticsproceedings.org/rss16/p074.pdf

筆者

Stagsted, R. K., Vitale, A., Binz, J., Renner, A., Larsen, L. B., Sandamirskaya, Y.,

参照されているモデル

DAVIS240C

Feedback control of event cameras

https://tub-rip.github.io/eventvision2021/papers/2021CVPRW_Feedback_control_of_event_cameras.pdf

筆者

Delbruck, T., Graca, R., Paluch, M.,

参照されているモデル

DAVIS346

Neuromorphic Vision Based Control for the Precise Positioning of Robotic Drilling Systems

https://arxiv.org/pdf/2201.01626.pdf

筆者

Ayyad, A., Halwani, M., Swart, D., Muthusamy, R., Almaskari, F., Zweiri, Y.,

参照されているモデル

DAVIS346

障害物回避 (Obstacle Avoidance)

EVDodgeNet: Deep Dynamic Obstacle Dodging with Event Cameras

https://arxiv.org/pdf/1906.02919.pdf

筆者

Sanket, N.J., Parameshwara, C.M., Singh, C.D., Kuruttukulam, A.V., Fermüller, C., Scaramuzza, D., Aloimonos, Y.,

参照されているモデル

DAVIS240B,DAVIS240C

Event-based Agile Object Catching with a Quadrupedal Robot

https://arxiv.org/abs/2303.17479

筆者

Forrai, B., Miki, T., Gehrig, D., Hutter, M., Scaramuzza, D.,

参照されているモデル

DVXplorer

宇宙 (Space Applications)

Star Tracking using an Event Camera

筆者

Chin, T.-J., Bagchi, S., Eriksson, A., van Schaik, A.,

参照されているモデル

DAVIS240C

OBSERVATIONAL EVALUATION OF EVENT CAMERAS PERFORMANCE IN OPTICAL SPACE SURVEILLANCE

https://conference.sdo.esoc.esa.int/proceedings/neosst1/paper/475/NEOSST1-paper475.pdf

筆者

Zolnowski, M., Reszelewski, R., Moeys, D.P., Delbruck, T., Kaminski, K.,

参照されているモデル

DAVIS240C

Event-based Star Tracking via Multiresolution Progressive Hough Transforms

筆者

Bagchi, S., Chin, T.-J.,

参照されているモデル

DAVIS240C

触覚センシング・アプリケーション (Tactile Sensing Applications)

Neuromorphic Event-Based Slip Detection and Suppression in Robotic Grasping and Manipulation

https://ieeexplore.ieee.org/document/9171323

筆者

Muthusamy, R., Huang, X., Zweiri, Y., Seneviratne, L., Gan, D.,

参照されているモデル

DAVIS240C

オブジェクトのポーズ推定 (Object Pose Estimation)

人間の姿勢推定 (Human Pose Estimation)

Neuromorphic high-frequency 3D dancing pose estimation in dynamic environment

https://www.sciencedirect.com/science/article/pii/S0925231223005118

筆者

Zhang, Z., Chai, K., Yu, H., Majaj, R., Walsh, F., Wang, E., Mahbub, U., Siegelmann, H., Kim, D., Rahman, T.,

参照されているモデル

DAVIS346

ハンドポーズの推定 (Hand Pose Estimation)

EventHands: Real-Time Neural 3D Hand Pose Estimation from an Event Stream

https://arxiv.org/pdf/2012.06475.pdf

筆者

Rudnev, V., Golyanik, V., Wang, J., Seidel, H.-P., Mueller, F., Elgharib, M., Theobalt, C.,

参照されているモデル

DAVIS240C

Event-based Non-Rigid Reconstruction from Contours

https://bmvc2022.mpi-inf.mpg.de/0078.pdf

筆者

Xue, Y., Li, H., Leutenegger, S., Stueckler, J.,

参照されているモデル

DAVIS240C

データ暗号化 (Data Encryption)

Event Encryption: Rethinking Privacy Exposure for Neuromorphic Imaging

https://arxiv.org/abs/2306.03369

筆者

Zhang, P., Zhu, S., Lam, E. Y.,

参照されているモデル

DAVIS240C,DAVIS346

核検証 (Nuclear Verification)

KEEPING SECRETS AT A DISTANCE NEW APPROACHES TO NUCLEAR MONITORING & VERIFICATION

https://sgs.princeton.edu/sites/default/files/2022-06/ALX-2022-CASA-REV3.pdf

筆者

A. Glaser,

参照されているモデル

DAVIS346

光学 (Optical Applications)

オートフォーカス (Auto-focus)

Autofocus for Event Cameras

筆者

Lin, S., Zhang, Y., Zhang, L., Zhou, B., Luo, X., Pan, J.,

参照されているモデル

DAVIS346

Millisecond autofocusing microscopy using neuromorphic event sensing

https://www.sciencedirect.com/science/article/abs/pii/S0143816622003001?via%3Dihub

筆者

Ge, Z., Wei, H., Xu, F., Gao, Y., Chu, Z., So, H., Lam, E.,

参照されているモデル

DAVIS346

Improving Fast Auto-Focus with Event Polarity

https://arxiv.org/abs/2303.08611

筆者

Bao, Y., Sun, L., Ma, Y., Gu, D., Wang, K.,

参照されているモデル

DAVIS346

波面センシング (Wavefront sensing)

Shack-Hartmann wavefront sensing using spatial-temporal data from an event-based image sensor

https://opg.optica.org/oe/fulltext.cfm?uri=oe-28-24-36159&id=442638

筆者

Kong, F., Lambert, A., Joubert, D., Cohen, G.,

参照されているモデル

DAVIS240C

データセットとシミュレーター (Datasets and Simulators)

エミュレータとシミュレーター (Emulators and Simulators)

v2e: From Video Frames to Realistic DVS Events

筆者

Hu, Y., S.-C., Liu, Delbruck, T.,

参照されているモデル

DAVIS346

Differentiable Event Stream Simulator for Non-Rigid 3D Tracking

筆者

Nehvi, J., Golyanik, V., Mueller, F., Seidel, H.-P., Elgharib, M., Theobalt, C.,

参照されているモデル

DAVIS240C

データセット (Datasets (sorted by topic))

人間の姿勢推定 (Human Pose Estimation)

DHP19: Dynamic Vision Sensor 3D Human Pose Dataset

筆者

Calabrese, E., Taverni, G., Easthope, C., Skriabine, S., Corradi, F., Longinotti, L., Eng, K., Delbruck, T.,

参照されているモデル

DAVIS240

Neuromorphic high-frequency 3D dancing pose estimation in dynamic environment

https://www.sciencedirect.com/science/article/pii/S0925231223005118

筆者

Zhang, Z., Chai, K., Yu, H., Majaj, R., Walsh, F., Wang, E., Mahbub, U., Siegelmann, H., Kim, D., Rahman, T.,

参照されているモデル

DAVIS346

ステレオデプス推定 (Stereo Depth Estimation)

Multi-robot, Multi-Sensor, Multi-Environment Event Dataset

筆者

Chaney, K., Cladera, F., Wang, Z., Bisulco, A., Hsieh, M.A., Korpela, C., Kumar, V., Taylor, C.J. and Daniilidis, K.,

参照されているモデル

DAVIS240C,DAVIS346

オプティカル・フロー (Optical Flow)

Multi-robot, Multi-Sensor, Multi-Environment Event Dataset

筆者

Chaney, K., Cladera, F., Wang, Z., Bisulco, A., Hsieh, M.A., Korpela, C., Kumar, V., Taylor, C.J. and Daniilidis, K.,

参照されているモデル

DAVIS240C,DAVIS346

イベントからの強度画像再構成 (Intensity-Image Reconstruction from Events)

CED: Color Event Camera Dataset

https://rpg.ifi.uzh.ch/CED.html

筆者

Scheerlinck, C., Rebecq, H., Stoffregen, T., Barnes, N., Mahony, R., Scaramuzza, D.,

参照されているモデル

DAVIS346

Joint Filtering of Intensity Images and Neuromorphic Events for High-Resolution Noise-Robust Imaging

筆者

Wang, Z. W., Duan, P., Cossairt, O., Katsaggelos, A., Huang, T., Shi, B.,

参照されているモデル

DAVIS240,DAVIS240B,RGB-DAVIS

ヴィジュアルオドメトリーとSLAM (Visual Odometry and SLAM)

Event-based, Direct Camera Tracking from a Photometric 3D Map using Nonlinear Optimization

https://rpg.ifi.uzh.ch/docs/ICRA19_Bryner.pdf

筆者

Bryner, S., Gallego, G., Rebecq, H., Scaramuzza, D.,

参照されているモデル

DAVIS240C,DAVIS346

The UZH-FPV Drone Racing Dataset High-speed, Aggressive 6DoF Trajectories for State Estimation and Drone Racing

筆者

Delmerico, J., Cieslewski, T., Rebecq, H., Faessler, M., Scaramuzza, D.,

参照されているモデル

DAVIS346

DDD20 End-to-End Event Camera Driving Dataset: Fusing Frames and Events with Deep Learning for Improved Steering Prediction

https://arxiv.org/abs/2005.08605

筆者

Hu, Y., Binas, J., Neil, D., Liu, S.-C., Delbruck, T.,

参照されているモデル

DAVIS346

The GRIFFIN Perception Dataset: Bridging the Gap Between Flapping-Wing Flight and Robotic Perception

https://arxiv.org/pdf/2101.10371.pdf

筆者

Rodríguez-Gómez, J. P., Tapia, R., Paneque, J. L., Grau, P., Gómez Eguíluz, A., Martínez-de Dios, J. R., Ollero A.,

参照されているモデル

DAVIS346

TUM-VIE: The TUM Stereo Visual-Inertial Event Dataset

https://cvg.cit.tum.de/data/datasets/visual-inertial-event-dataset

筆者

Klenk S., Chui, J., Demmel, N., Cremers, D.,

参照されているモデル

DAVIS240C,DAVIS346,DAVIS346B

Multi-robot, Multi-Sensor, Multi-Environment Event Dataset

筆者

Chaney, K., Cladera, F., Wang, Z., Bisulco, A., Hsieh, M.A., Korpela, C., Kumar, V., Taylor, C.J. and Daniilidis, K.,

参照されているモデル

DAVIS240C

認識 (Recognition)

DET: A High-resolution DVS Dataset for Lane Extraction

筆者

Cheng, W., Luo, H., Yang, W., Yu, L., Chen, S., Li, W.,

参照されているモデル

DAVIS240C

Neuromorphic Vision Datasets for Pedestrian Detection, Action Recognition, and Fall Detection

https://www.frontiersin.org/articles/10.3389/fnbot.2019.00038/full

筆者

Miao, S., Chen, G., Ning, X., Zi, Y., Ren, K., Bing, Z., Knoll, A.,

参照されているモデル

DAVIS346

イベント・デノイジング (Event Denoising)

Event Probability Mask (EPM) and Event Denoising Convolutional Neural Network (EDnCNN) for Neuromorphic Cameras

筆者

Baldwin R.W., Almatrafi M., Asari V., Hirakawa K.,

参照されているモデル

DAVIS346

お客様用ご相談/お問い合わせ

製品に関するご相談、デモ機器、お見積・納期などに関して お気軽に問い合わせ下さい

※は入力必須項目となります。

INFORMATIONお知らせ

-

2026.03.23

新製品

-

2025.11.12

新製品

-

2025.07.01

新製品

-

2025.03.31

お知らせ

-

2024.12.26

新製品